■新宿西口通路の壁面

大江戸線都庁前駅から新宿に向かう西口通路の壁面に、オリンピック・パラリンピック大会の告知映像がいくつも展示されています。観光客が時折、その前でポーズを取り、写真を撮っているのを見かけます。そんな時、スポーツの祭典であるオリンピックは観光資源でもあったことに気づきます。

展示されていたのは工学院大学前の壁面です。

市松模様を組み込んでデザインされたマスコット・キャラクターがいかにも幾何学的で、未来の技術を連想させます。まるでヒト型ロボットのようだと思った途端、ネットで見かけた画像を思い出しました。

調べてみると、これは、2020年東京大会のために制作されたマスコットロボットでした。身長160㎝、体重15.7㎏で、ミライトワと命名されています。離れたところからロボット同士が握手することができ、搭載されたカメラでヒトの接近を感知し、相手の動作ごとに目の表情を変化させることができるといいます。

(※ https://tokyo2020.org/jp/games/vision/innovation/data/robot_panel_A4.pdf)

実は、オリンピックは日本の技術力を世界に向けてアピールできる場でもあるのです。オリンピックを機に、大会で使えるさまざまなロボットが開発されていました。

(https://global.toyota/jp/newsroom/corporate/28713215.htmlより)

たとえば、ミライトワのようなヒューマノイドロボット、遠隔地コミュニケーションサポートロボット、フィールド競技サポートロボット、等々です。オリンピック、パラリンピックをサポートするためのロボットが、機能別にさまざま製作されていました。

中には、超高齢社会を見据えて開発されたような生活支援ロボットもあります。こちらは、オリンピック大会時には観戦サポートロボットとしての役割を担うといいます。いずれも情報通信工学を使ったものです。

(※ https://tokyo2020.org/jp/games/vision/innovation/)

それでは、情報通信工学技術はオリンピックを機に、私たちに何をもたらしてくれるのでしょうか。

■オリンピックを機に、ICTの進展を目指す

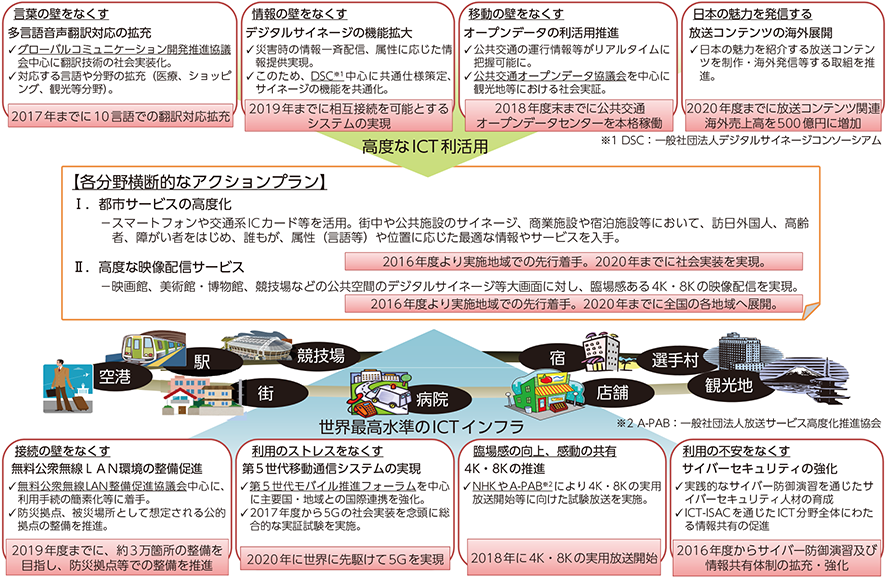

『平成30年版情報通信白書』によると、総務省はオリンピックを機に、日本の持続的成長を見据え、次のようなアクションプランを策定しています(※ https://www.soumu.go.jp/johotsusintokei/whitepaper/ja/h30/html/nd261210.html )

これを見ると、上部に、「言葉の壁をなくす」、「情報の壁をなくす」、「移動の壁をなくす」、「日本の魅力を発信する」といった項目が提示されています。これらが目標なのでしょう。2020年東京大会を機に、言語、情報、移動のバリアフリー化を進め、日本の魅力を発信するためのICTの利活用が企図されていることがわかります。

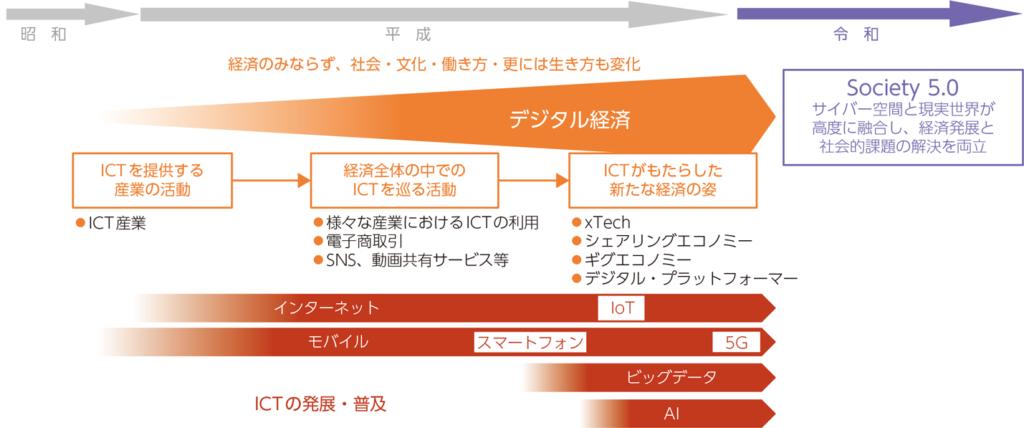

『令和元年版情報通信白書』では、昭和、平成、令和に至るICTの発展プロセスが図で示されています。

(※ https://www.soumu.go.jp/johotsusintokei/whitepaper/ja/r01/html/nb000000.html)

この図からは、令和の始まりとともに、Society5.0を本格始動させようとしていることがわかります。平成後半にはモバイルメディアであるスマホが普及し、令和2年(2020年)には携帯各社が5Gサービスを開始します。社会を支える情報通信インフラが大きく変化していく時期にさしかかっているのです。

IoT、AI、ビッグデータなどもすでに実用段階に入っています。オリンピックが開催される2020年はまさに、テクノロジー主導で激動する時代の幕開けになるのです。

それでは、高度なICTを使ってどのようなサービスが可能なのでしょうか。

先ほどのアクションプラン図を見ると、真ん中から下に4項目の内容が書かれています。それぞれ、期限を設けた実現目標も書かれていますから、政府が2020東京大会を目途に社会のICT化を進め、バリアフリー化を実現していこうとしていることがわかります。

■バリアフリー化の推進

確かに、オリンピック、パラリンピック大会に備え、移動、言語や情報のバリアフリー化が進められています。

『令和元年版障碍者白書』を見ると、2020年東京大会に向けた取組みが説明されています。

(※ https://www8.cao.go.jp/shougai/whitepaper/r01hakusho/zenbun/pdf/s1_3.pdf)

具体的には、「心のバリアフリー」、「ユニバーサルデザインの街づくり」などが挙げられており、それぞれについて行動目標が示されています。障碍者や訪日する外国人に分け隔てなく接する心構えを養うとともに、彼らが不自由なく移動でき、コミュニケーションできるよう、社会環境を整備しようというのです。

「ユニバーサルデザインの街づくり」で設定された6項目のうち、第5項目に、「ICTを活用したきめ細かい情報発信・行動支援(バリアフリー情報提供機能強化等)」があります。これは外国人や視聴覚障碍者等に対する情報保障であり、障碍者に対する移動保障といえるものです。

その内容を見ると、無料公衆無線LAN環境の整備、「言葉の壁」をなくす多言語音声翻訳システムの高度化、4K・8Kやデジタルサイネージの推進、第5世代移動通信システムの実現、といった具合です。盛りだくさんの内容に見えますが、5Gを活用して言語や情報のバリアフリー化を目指そうとしている点で、これは明らかに訪日する外国人を対象にした取組みです。

もちろん、言語や情報バリアフリーのために開発された技術はいずれ、視聴覚障碍者や高齢者にも役立つよう改変されていくでしょう。

日本はいま超高齢社会に突入しています。高齢化に伴い、さまざまなことが懸念されるようになっています。その最たるものが、高齢者の心身機能の低下に伴うコミュニケーション不全状況をどのように回避できるかということでしょう。

オリンピック、パラリンピックを機に、言語や情報のバリアフリー化が推進されれば、閉会後、超高齢社会が抱える課題の一つが解決されるようになるかもしれません。

それでは、多言語音声翻訳システムがどのようなものなのか、みていくことにしましょう。

2014年3月19日、多言語対応の強化・推進のために多言語協議会が設置されました。2020年オリンピック・パラリンピック東京大会の開催に向けて設立された組織です。その後、多言語協議会は、国や地方の関係機関、民間の関係機関や企業と連携し、協働してシステムの開発に取り組んできました。

(※ https://www.2020games.metro.tokyo.lg.jp/multilingual/council/pdf/kangaekatah290622.pdf)

その結果、開発されたのが、「ボイストラ(VoiceTra)」という名前のアプリです。現在、31か国語に対応しており、無料で使うことができます。インストールのマニュアルは日本語と英語で提供されており、操作方法などもわかりやすく提示されています。

こちら → http://voicetra.nict.go.jp/manual.html

VoiceTraの「紹介編」と「使い方編」が動画で提供されていました。ここでは、「使い方編」を見てみることにしましょう。

こちら → https://youtu.be/RSvsBv6TZ7M

日本語音声に日本語字幕が付いています。この動画には他言語版として英語、中国語、韓国語が用意されています。求める言語をクリックすると該当ページに移動します。これを見ると、内容は単純ですが、必要最小限度のコミュニケーションはできるようになっています。日本語がわからない外国人にとっては貴重なデバイスです。もちろん、外国語のわからない日本人にとっても有益です。

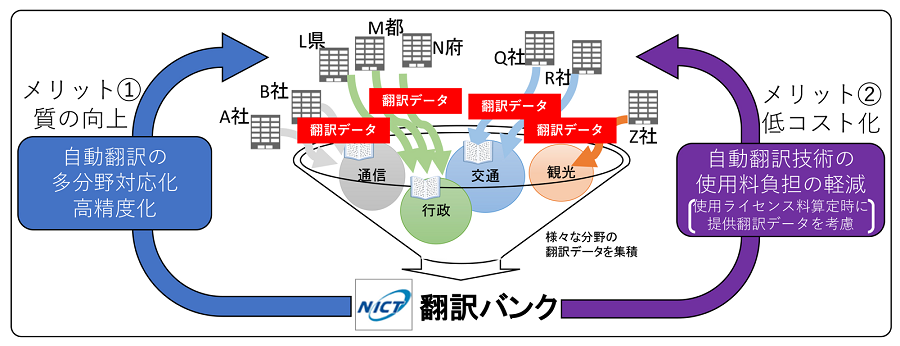

もっとも、ヒトのコミュニケーション内容は多様ですから、これだけで済むはずがありません。より満足できるコミュニケーションを目指そうとすれば、語彙を増やし、翻訳の精度を向上させる必要があります。それには翻訳データベースの充実を図ることが必要でしょう。そう思って調べてみると、総務省と情報通信機構(NICT)はすでに翻訳バンクを構築し、運用を開始していました。

(※ https://www.nict.go.jp/press/2017/09/08-1.html)

翻訳バンクは次のようなコンセプトで構築され、運用されています。

ここで示されたように、さまざまな分野の翻訳データを数多く蓄積すれば、翻訳の精度を高め、より多くの分野の翻訳に対応できるようになります。AIによってビッグデータを活用することによって、量が質を向上させていくのです。

その一方で、データの提供者には使用料の軽減を図ることで対応していくとしています。双方にメリットがあるよう計らいながら、翻訳バンクの充実を目指しているのです。ビッグデータとAIの利活用によって、時間が経てば、使い勝手がよく、利用者の満足度の高いシステムになっていくでしょう。

■言語、情報のバリアフリー化

政府はオリンピック開催を機に、外国人滞在者のための言語、情報のバリアフリー化を推進しようとしています。

その基本理念は、「多様な主体が表示・標識等の多言語対応に取り組むことにより、外国人旅行者が 円滑に移動し、安心して快適に滞在できる都市環境の向上を目指す」と書かれています。

(※ https://www.2020games.metro.tokyo.lg.jp/multilingual/council/pdf/kangaekata.pdf?1412)。

対象者は、「2020 年オリンピック・パラリンピック東京大会開催時の外国人旅行者、観光・ビジネス等で日本を訪れる外国人旅行者」とされています。彼らに対し、「日本語+英語及びピクトグラムによる対応を基本としつつ、需要、地域特性、視認性などを考慮し、必要に応じて、中国語・韓国語、更にはその他の言語も含めて多言語化を実現」し、利便性を図っていくというのです。日本に短期間滞在する外国人を対象にしていることがわかります。

対応するツールとしては、「交通機関や道路の案内表示や標識等、 飲食や宿泊、観光やサービス施設における案内表示や標識等、音声案内、パンフレット、ICTツールなどの各種媒体」が挙げられています。

これを見る限り、言語、情報のバリアフリーを謳いながら、基盤メディアであるTVは対象になっていないことがわかります。どうやら、来日した外国人が滞在期間中に不自由なく行動できるように、案内や標識を多言語化するのが主な目的のようです。

考えてみれば、日本を訪れる外国人旅行者数は激増しています。2013年に初めて1000万人を突破して以来、2014年には1300万人を超え、2016年には約2400万人といった具合です。このような状況からみれば、2020年の東京大会には、さらに多くの外国人旅行者が日本を訪れることでしょう。来日した外国人が快適に滞在できるよう、言語や情報のバリアフリー化を進めるのは当然のことです。

ところが、この施策の中にTV字幕は対象とされていませんでした。「ユニバーサルデザインの街づくり」の下、標識や案内などのバリアフリー化が推進され、無料公衆無線LAN環境の整備が提唱されているにもかかわらず、基盤メディアともいえるTVの字幕は対象とされていないのです。

■なぜ、TV字幕は言語・情報のバリアフリー化の対象ではないのか

2020年東京大会に訪れる観光客やそれ以外の目的で訪れる外国人、いずれもホテルに宿泊し、何日間かの滞在中、日本のTVを見るはずです。

オリンピックで来日したとなれば当然、ホテルでTV観戦するでしょうし、ニュースや日本のドラマなども見たりするでしょう。TVはありのままの日本を知ってもらうには絶好の媒体なのです。

来日した外国人はホテルに着くとまずTVを見ます。その際、画面から流れる日本語音声に英語字幕だけではなく、日本語字幕も表示できるようになっていれば、どれほど喜ばれることでしょう。

字幕があれば、日本語のわからない外国人でも音声と文字とを照合しやすく、理解しやすくなります。日本語字幕があれば、TVを見て日本語の学習意欲が喚起されるでしょうし、手軽な日本語学習ツールにもなります。日本語字幕のおかげで少しでも日本語を理解できるようになれば、日本への関心も高まるでしょう。

もちろん、日本語字幕は外国人のためばかりではありません。聴覚障碍者や聴覚機能が低下している高齢者にも役立ちます。そう考えると、オリンピック、パラリンピックを機に言語、情報のバリアフリー化を目指すなら、誰もが接触するTVに日本語と英語の字幕を表示できるようにすることは不可欠でしょう。

そもそも放送事業は総務省の管轄下にあります。ですから、総務省がTV字幕についてどのような見解を抱き、どのような政策を展開しているのか知っておく必要があるでしょう。果たして総務省の見解はどうなのでしょうか。

調べてみると、アクセシビリティの観点から、総務省は平成30年度(2018年)に、今後10年間の字幕放送、解説放送及び手話放送の普及目標を定めた指針を策定していました。

(※ https://www.soumu.go.jp/main_content/000642553.pdf)

平成9年(1997年)以降、総務省は10年ごとに普及目標を設定し、着実にTVアクセシビリティの向上に努めていたのです。

■放送分野におけるアクセシビリティに関する指針

2018年2月7日、総務省は『放送分野におけるアクセシビリティに関する指針』を策定し、次のように発表しました。

こちら → https://www.soumu.go.jp/main_content/000531258.pdf

主な改正点としては,「字幕放送の普及目標対象放送時間を1時間拡大して18時間に」、「独立U局を除く県域局と放送衛星で、字幕・解説放送の目標数値を明示」、「NHK、地上系民放(県域局以外)の解説放送目標を15%に引き上げ,手話放送で初めて数値目標を設定する」等々です。

この指針を策定する前に総務省は、『放送分野におけるアクセシビリティに関する指針』(案)として提示し、パブリックコメントを募っていました。その結果、次のような意見が提出されました。法人から10件、個人から10件です。

こちら → https://www.soumu.go.jp/main_content/000531717.pdf

全般に解説放送に関する意見が多くみられます。字幕放送に比べ、対応が不十分だからでしょう。今回の指針で多少、改善されています。

放送アクセシビリティとしては当然、解説放送を充実させていかなければなりませんが、ここでは字幕放送についての意見の中で印象に残ったものを取り上げることにします。個人、NHK、民放の一部から提出された意見は概略、次のようなものでした。

個人:「非常時や年末年始の字幕がなくなってしまう際、音声認識ソフ トを活用して代替する」、「情報保障という考え方を業界に浸透させる」、「海外の事例を参考に、国内でも字幕付与の義務化を実現してほしい」、「インターネットで公開する際にも字幕付与を進め てほしい」「パラリンピックの放送は、今の所、NHKのみです。しかもEテレと言う状況でこれを総合テレビに格上げしてほしいのと皿に民放でも放送できないものか検討して頂きたいものです。2020年東京五輪より民放でもパラリ ンピックも放送できないか?各局で話し合って頂きたいものです」

NHK:「NHKは、「指針(案)」に示された普及目標の対象となる放送時間について、視聴者の多い時間帯に付与することが望ましいとの方針も含め、妥当であると考えます。衛星放送への字幕付与については、生放送番組の字幕付与体制が整っていないなどの課題がありますが、字幕付与の効果がより高いと期待されるBSプレミアム を中心に拡充に努めてまいります。また深夜、早朝の時間帯であっても、台風等の影響が予測される場合は字幕放送の体制を整えて臨むとともに、大規模災害が発生したときにはできるだけ速やかに体制を整え、字幕放送を開始できるよう努めていきます。字幕の表示方法についても、改善すべく研究を進めます。一方で、 諸外国と比較し、日本では字幕放送に求められる正確さの水準が 高いことが、字幕放送普及を難しくしていることを踏まえ、関係 各署と制度面の課題について検討していきたいと考えています」

中京TV:「字幕放送制作に係る費用や人材確保の負担は極めて大きく、指針案に示された 2018 年度以降の目標達成は簡単ではないと認識しています。 弊社は、広域局とはいえ在京局や在阪局と比較すると規模や資 金面では大きな差があります。今後、音声認識技術の向上や自動字幕生成技術の発展がない限り、在京局や在阪局と同水準の目標達成については、多くの困難があると認識しています。以上のように課題も多く厳しい環境ではありますが、目標達成に向けて取り組んで参ります」

字幕についての意見で印象に残ったものは概略、以上のようなものでした。これらについての総務省の見解は下記の表の右側の項に示されています。

こちら → https://www.soumu.go.jp/main_content/000531719.pdf

これらを読むと、字幕放送については現段階で可能なことは相当、達成できているように思えます。果たして実際はどうなのでしょうか。総務省の資料から、字幕放送の直近の実績を見てみることにしましょう。

■字幕放送

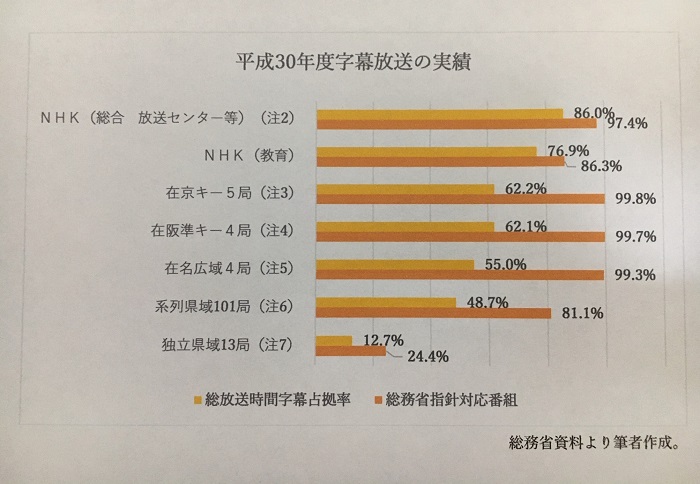

NHK、民放キー局、準キー、ローカル局等の平成30年度(2018年)字幕付与の実績についてみたのが、下記のグラフです。

総務省資料より筆者作成。

これを見ると、NHK、在京キー局、在阪準キー5局、在名広域4局とも、総務省指針に対応する番組については97.4%、99.8%、99.7%、99.3%といった具合に、かなり高い率で字幕が付与されていることがわかります。NHK教育と系列県域101局は80%台にとどまっていますが、それでも高い付与率です。総務省対応番組への字幕付与は、現段階ではもはや難しいものではなくなっているのでしょう。このデータからは、字幕付与コストが軽減されれば、どの局も字幕付与率はさらに向上すると考えられます。

総務省は今回の指針で、NHK、民放キー局、準キー局、在阪広域4局には「対象の放送番組全てに付与」とし、系列県域101局には「2027年度までに対象の放送番組の80%以上に字幕付与。できる限り、対象の全てに字幕付与」と数値目標を設定しています。

ちなみに、「対象の放送番組」とは、次の①~④を除く全ての放送番組を指します。

①技術的に字幕を付すことができない放送番組(例:現在のところ複数人が同時に会話を行う生放送番組)

②外国語の番組

③大部分が器楽演奏の音楽番組

④権利処理上の理由等により字幕を付すことができない放送番組

総務省がこの指針を策定したのが2018年7月で、グラフで示した字幕放送の実績は2018年度のものです。どの局も対象番組については字幕付与率が高いので、この目標は期間内に達成できるでしょう。

もっとも、指針には「本指針は、技術動向等を踏まえて、5年後を目途に見直しを行う」とされていますから、上記①から④のうち、②については新たに対象番組に組み入れられるかもしれません。

上のグラフを見ると、総放送時間に占める字幕付与率がどの局も全般に低いのが気になります。とくに系列県域局、独立県域局で低いのが目立ちます。これらの放送局ではおそらく、事前収録番組よりも、自社制作の生放送番組の比率が高いからでしょう。その方が制作費を抑制できるからですが、その結果として、字幕付与率が低くなっています。

ローカル局では一般に、制作費を抑制するため、自主制作の生放送番組が多い傾向がみられます。ところが、生放送番組は字幕を付与しにくいうえに、誤りも発生しやすく、しかも、放送局は字幕付与に多大なコスト負担を強いられます。

NHK、民放キー局、県域局を問わず、放送局にとって、生放送番組への字幕付与が大きな課題になっています。

■総務省字幕支援事業

日本社会の動向を考えてみれば、超高齢化が今後も続き、労働移民や来日観光客は増え続けます。もはや言語・情報のバリアフリー化だけではなく、基幹メディアとしてのTVに日本語字幕を付与することが不可欠になるでしょう。高齢者や聴覚障碍者だけではなく、外国人をも視野にいれた字幕付与が必要になってくるのです。

そのような現状認識が共有されているのでしょうか、字幕に関する技術はいま、さまざま開発されており、総務省もその支援事業を進めています。

総務省が募集した平成30年度字幕支援事業には、2件の事業案が採択されました。1件はマルチスクリーン放送協議会による事業案で、もう一つはヤマハによる事業案でした。

(※ https://www.soumu.go.jp/main_content/000554092.pdf)

それぞれ実証実験の結果が報告されているようです。

こちら → https://www.soumu.go.jp/menu_news/s-news/01ryutsu09_02000227.html

結果を知りたくて、いろいろ探してみました。ヤマハの事業案に関しては報告書も出ていましたが、マルチスクリーン放送協議会の事業案に関してはどこを探しても、その報告書が見当たりませんでした。

もっとも、マルチスクリーン放送協議会の事業案も実証実験は行われていたようです。『放送研究と調査』2019年1月号で関連記事を見つけましたが、次のように書かれていました。

「生放送の音声から字幕を自動的に生成しスマートフォンに配信する実証実験が、11月19日から30日にかけて、全国の民放24局で行われた。(中略)今回の実証実験には、在阪民放5社で構成する「マルチスクリーン放送協議会」が開発した「字幕キャッチャー」を使用。このシステムには、NHK放送技術研究所や情報通信研究機構(NICT)の音声認識の技術が導入されていて、各局は5日間、夕方のニュースなどの音声から自動生成した字幕をスマホに配信し、障碍者や高齢者の反応を集めている。協議会によると、「字幕キャッチャー」を用いた場合、遅れは5秒程度にとどまるとしている。一方、文意は読み取れるものの、漢字などが正しく表示されないケースも見られ、視聴者が字幕の正確さをどの程度必要としているかについても調べる」(※ 越智慎司、「生放送の字幕を自動生成しスマホに配信、民放24局で実験」、『放送研究と調査』2019年1月号、p.97.)

「字幕キャッチャー」を使って実証実験を行い、実際の放送番組を対象に、聴覚障碍者や高齢者の反応も取っていたようです。報告書という形では見つかりませんでしたが、実証実験を行っているのですから、当然、何らかの結果は出ているのでしょう。

さて、総務省が平成30年度支援事業として採択した2件のうちのもう一つが、ヤマハの「SoundUD」を使って字幕をスマホ等に配信して表示させるシステムでした。

ヤマハが開発した「SoundUDクラウド」はこれまで、主に交通や防災などの場面で活用されてきました。この実績を踏まえ、TVやラジオの音声を字幕情報として視聴者のスマホに送信するというのがこの事業の特徴です。

その中核技術になるのが、音声トリガーです。これをTVの字幕付与サービスに活用しようというのです。

こちら → https://www.soumu.go.jp/main_content/000524687.pdf

このシステムでは、アナウンサーの音声が自動的に認識されて、トリガー生成された発話内容が蓄積サーバに送られ、トリガー音声としてTVで放送されます。発話内容はトリガー情報として、対応アプリをインストールしたスマホに字幕を表示されるといいます。発話内容がトリガー生成されることによって、音声としてもデジタル情報としても活用することができるというのです。

興味深いのは、画面に字幕を付与するのではなく、セカンドスクリーンとしてのスマホに、字幕を送信するということでした。ヤマハは、このシステムであれば、これまでのTV字幕に伴うさまざまな課題に対処できるといいます。

つまり、これまでは字幕を付けることによって画面が見づらくなっていましたし、字幕付与のコスト負担が放送局の経営を圧迫するといった課題がありました。インターネット経由で字幕をスマホに表示できるこのシステムでは、それらの課題を一挙に解消できるというのです。(※ https://www.yamaha.com/ja/news_release/2018/18072401/)

実証実験の結果、アプリを利用してスマホに字幕を表示させた場合、外国人は100%(35人/35人)、障碍者(車いす)75%(3人/4人)、聴覚障碍者約90%(27人/29人)の評価を得ています。サイネージの場合も同様、外国人100%、障碍者(車いす)75%、聴覚障碍者80%でした(※『総務省報告書概要版』、p.4. https://www.soumu.go.jp/main_content/000625562.pdf)

このような結果を踏まえ、総務省は「施設管理者および実証実験参加者の双方より、ICTを用いた情報伝達は有効であるとの回答を得ました」と総括しています。

具体的にいうと、次のような回答が見られました。

「ICTは、属性毎に情報の内容や言語を変えることができ、障碍を持った方や外国人の方にも情報を提供できるため非常に有効である」、

「競技会場のどこにいても一斉に多くの来訪者に情報が伝わるので良いシステムであると思う」、「今回実証したスマートフォンアプリは、電源喪失や通信障害など災害時における情報伝達手段として、非常に有効であると思われる」、

「サイネージは大画面であり、視覚的に情報が見やすい。また、情報を多言語で表示できる点が有効だ」等々です。

ところが、この報告書をよく読むと、その内容はオリンピック会場でのスマホとサイネージへの字幕表示に関するもので、放送事業に関する記載はありませんでした。

先ほどもいいましたように、マルチスクリーン放送協議会の字幕事業についての報告書はありませんでした。これらを考え合わせると、両事案とも放送に関する実証実験の結果が良くなかった可能性があります。おそらく、いずれも実用化レベルには達していなかったのでしょう。

そう思って、調べていると、総務省が補正予算を組んで、聴覚障碍者放送視聴支援事業の募集しているのがわかりました。

■平成30年度第二次補正予算における支援事業

総務省は2019年2月1日から25日にかけて、補正予案で「聴覚障害者放送視聴支援緊急対策事業」を募集していたのです。平成30年度セカンドスクリーン型実証実験の報告会が開催されたのが3月8日でしたから、1月末には両事案の実証実験の結果が総務省にはわかっていたのでしょう。

総務省は3月29日、補助金(情報通信利用促進支援事業費補助金)の交付先を決定しています。

こちら → https://www.soumu.go.jp/menu_news/s-news/01ryutsu09_02000228.html

事業タイトルは異なっていますが、今回も聴覚障碍者に向けた字幕付与事業であることに変わりはありません。そこで、調べてみると、案の定、先ほどの事業案の実証実験で誤って字幕が表示された例が報告されていました。

具体的にいえば、「所有」と発音したアナウンサーの音声が「醤油」として字幕表示されたり、「六度」が、「鹿路」、「三度」が「サンド」、「七度」が「ななど」といった具合に、数字が誤って認識されてしまったケースです。(※『総務省の情報アクセシビリティ支援の取り組み例』、2019年2月18日)。

このように、両事業の実証実験では、聞き取りやすいはずのアナウンサーの音声に対して誤った反応を示す例がいくつか見受けられたのです。

オリンピック、パラリンピック開催までに間もないというのに、両事業案で実用化できるレベルの結果が得られなかったのですから、総務省としても立て直す必要があったのでしょう。この報告書が出されたのが、2019年2月18日でした。この時点で、すでに補正予算による事業募集が始まっていました。

そして、3月29日に公表された補正予算枠で採択された事業が、国立研究開発法人・情報通信研究機構による「放送番組用音声認識システムによる自動字幕表示システム」でした。

こちら → https://www.soumu.go.jp/main_content/000611220.pdf

事業の概要欄からは、「自動字幕付与技術の強化により、聴覚障害者や高齢者を含む多くの視聴者がテレビジョン放送の内容を理解し、情報アクセスの機会を確保できるようにする」ことを目的にしていることがわかります。最後に、「本事業の成果を用いて自動字幕表示システムを2020年度に実用化し、実運用することを目指す」と書かれており、ここに総務省の焦りが透けて見えます。

さて、この研究では、二つのセクションが注目されます。一つは「放送番組用音声認識システム」で、もう一つは「自動字幕表示システムの開発、試験運用及び評価」です。

まず、「放送番組用音声認識システム」については、2500時間の放送番組からデータを収集して音声データとテキストデータに分けて格納し、それに最新の単語情報を加え、放送番組用にカスタマイズしたものを音声認識システムにあげるという流れになっています。

興味深いのは、放送番組の多様で大量のデータを音声データとテキストデータとに分けて格納し、いつでも引き出せる状態にしていること、放送番組のデータベースに最新の単語情報を加えてカスタマイズし、音声認識システムに組み込んでいることでした。認識の精度をあげるためでしょう。

そういえば、マルチスクリーン放送協議会とヤマハの実証実験の際、音声を誤って認識し、字幕表示していたことがありました。おそらく、それを避けるための処置なのでしょう。音声認識に至る前段階で、2500時間分もの放送番組から音声データとテキストデータの集積し、データ量を増やしています。音声認識の精度をあげるために、できるだけ多様で大量のデータベースを構築しているのです。

次に、「字幕表示システム」の段階では、さらに複雑なシステムになっています。

音声認識システムを経て、音声認識サーバーに送信されたデータは放送音声等と照合して認識され、字幕蓄積・配信サーバーに送信されます。その後、自動生成された字幕がスマホ、タブレット、セットトップボックス(STB)等のメディアに配信され、表示されます。

最後に、各媒体の画面に表示された字幕について、聴覚障碍者等の評価を得て、システムを修正していくという仕組みです。

STBを介したTVではアウトリーチ型字幕となり、スマホではセカンドスクリーン型字幕となります。いくつもの段階で誤表示がないような工夫がされています。これについての実証実験はこれからですが、担当するのが情報通信機構(NICT)ですから、マルチスクリーン放送協議会とヤマハの実証実験の結果を継承した成果が期待されます。

というのも、ヤマハは音声トリガーとNICTが開発した音声認識エンジンを組み合わせてシステム構築を行っていましたし、マルチスクリーン放送協議会はNHK技研が開発した音声認識エンジンとNICTが開発した音声認識エンジンを使っていました。両事業案とも音声認識エンジンとしてNICTが開発したものを使っていたのです。今回の実証実験では、NICTが開発した音声認識エンジンに一本化して実用化が試されることになるのです。

■今後はAIハイブリッド型字幕・・・?

2018年2月に発表された総務省の指針によって、ローカル局も2027年までに生放送番組への字幕付与に取り組まざるを得なくなりました。資本力、マンパワーが不足しているといって回避していられない事態になっているのです。

2020年1月16日の日経新聞で、テレビ愛知がTV生字幕配信の実証実験を行うことを知りました。1月27日から31日放送の「ゆうがたサテライト」と2月2日放送の「データで解析!サンデージャーナル」で実証実験を行うというのです。

こちら → https://www.nikkei.com/article/DGXMZO54448050W0A110C2000000/

これは、TV音声をリスピーク方式と手入力方式で修正し、インターネットを通して字幕配信するというものです。受信機はパソコン、タブレット、スマホなどでセカンドスクリーン型字幕、あるいはTVのアウトリーチ型字幕になります。放送期間中に利用者に対しアンケート調査を実施し、今度の字幕配信や番組制作に役立てるといいます。

このシステムはアセット・ジャパンが開発したもので、同社はすでに聴覚障碍者のために、「情報保障サービスe-ミミ」を展開しています。

この延長線上に、今回のインターネットを介してTV字幕を配信するシステムを考案したのです。

そもそもは筑波技術大学等が開発した「モバイル型遠隔情報保障システム」の技術を基盤に構築されたものでした(※ https://www.tsukuba-tech.ac.jp/ce/mobile1/index.html)。

聴覚障碍者にとって、現在のTV字幕にはいくつか問題があります。とくに生放送字幕には大きな問題があります。それは、画面と字幕表示とに時間的なズレが生じることです。

新聞報道によると、テレビ愛知が実験したWeb字幕でも、音声を文字に変換し、数秒後にウェブ配信し字幕表示すると書かれています。このシステムで、音声と字幕表示とのタイムラグは解消できるのでしょうか。それがちょっと気になりました。

さて、これはAIハイブリッド型字幕になります。テレビ愛知に限らず、各放送局は今後のTV字幕について、このようなAIハイブリッド型を検討しているようです。

たとえば、TBSの場合、CS放送向けの24時間報道チャンネル「TBS NEWS」に字幕を付与するシステムを開発し、第45回放送文化基金賞を受賞しました。

(※ https://www.tbs.co.jp/company/news/pdf/201906051700.pdf)

このシステムでは、「アナウンサーが読むニュース原稿を字幕システムに取り込む方式」、「地上波ニュースで放送済み字幕を取り込む方式」、「音声認識AIを利用して字幕を生成する方式」の3つを併用したハイブリッド方式を採っています。このような方式を採用した結果、字幕の正確性、スピードアップ、運用のコストダウンを実現できたといいます。

2018年9月にこのシステムを本格的に運用して以来、大きなトラブルもなく、24時間TVニュースに字幕を付与できたことが評価されたのです。開発者の木村浩也氏は、今後はAIによる認識精度を高め、運用のコストダウンを図り、CS放送以外でも円滑に字幕付与できるようにしていきたいと述べています。

■5Gを利用した生中継映像の伝送

TBS広報部は2019年11月1日、5Gを利用した生中継の映像伝送に成功したことを発表しました。放送局側に設置したカメラリモートコントローラーと、中継地点の放送用ハイビジョンカメラを5G回線で接続し、放送スタジオと同等の放送品質を担保し、映像伝送できたというのです。

こちら → https://www.tbs.co.jp/company/news/pdf/201911011700.pdf

5Gの特徴は「高速・大容量・低遅延」だといわれています。そこで、TBSはNTTドコモの5Gサービスを利用し、日本で初めて、スタジオと同等の放送品質を担保し、生中継の映像伝送に成功したのです。

実際、11月1日に、地上波のTBS番組「あさチャン!」「ひるおび!」「TBSニュース」で、渋谷スクランブルスクエア開業初日の模様の一部が、NTTドコモの5Gサービスを利用して生中継で放送されました。

この生中継では、5Gのネットワークの上にVPN(Virtual Private Network)を構築し、TBS赤坂放送センターと中継地点とをダイレクトに接続しました。そして、赤坂放送センターに設置したカメラコントローラーで中継先カメラの遠隔制御を行い、映像を伝送したというのです。

生中継でもスタジオ映像と同等の放送品質を保ちつつ、伝送できるシステムを日本で初めて実用化したことになります。5Gの幕開きにふさわしい放送技術といえるでしょう。

TBSは今後、ここで使った遠隔番組制作手法を応用し、突発のニュース中継などでも高品質の中継を行えるようにするといいます。制作現場の人員の最適化を図りながら、クオリティの高い番組制作を進めていくと述べています。

■オリンピックを機に、字幕付与サービスは向上するか?

TV局にとって生放送番組への字幕付与は課題が多く、コスト負担も高い事業でした。ところが、AIを活用し、5Gを利用することによって、より精度が高く、コスト負担の低い字幕付与システムが可能になりつつあります。

すでに実用化されているものもあれば、今後、実証実験の結果を踏まえて改善されていくものもあります。いずれにしてもICTの進展に従い、TVへの字幕付与といった領域も大幅に改善されていくような気がします。

米ラスベガスで2019年12月2日から6日まで、アマゾンウエブサービス(AWS)の年次開発者会議「re: Invent 2019」が開催されました。参加したジャーナリストの西田宗知佳氏は、5Gは低遅延が特徴だといわれ、だからこそ自動運転も可能だといわれるが、公衆網を使った低遅延化には5Gがスタンドアローンになるまで待つ必要があると指摘しています。(※ https://www.watch.impress.co.jp/docs/series/nishida/1223145.htm)

現在の5Gで使われているのは、4Gのネットワークを活かして5Gを構成する「ノン・スタンドアローン(NSA)」と呼ばれる方式が中心になっているそうですが、西田氏はそれでは無理だというのです。低遅延を実現するには5G網にサーバーを配置することが必要だとしたうえで、「どのくらいの数をどのくらいのエリアに配置するのか」の判断が難しい」と説明します。そして、「5Gにおける低遅延を実現する技術の採算性」が問題になるとも述べています。

おそらく、それが現実なのでしょうが、たとえ現段階でそのような課題があったとしても、社会的に必要なものであれば、やがては技術改良されて使いやすくなり、コストダウンもされます。それがテクノロジーの辿ってきた道であるとすれば、5Gはいずれ、TV字幕に関する課題についても解決の糸口になってくれるでしょう。

日本では2020年、5Gサービスが開催されます。「高速、大容量、低遅延」が大きな特徴だといわれる5Gの環境下では、リアルタイムのコミュニケーションが実現するのです。

一方、オリンピックを機に、言語、情報のバリアフリー化が進められています。その一環としてTV番組にも英語と日本語の字幕が表示できるようになれば、視聴者層を拡大できるでしょう。

TVはいつの間にか、オールドメディアと呼ばれるようになり、若い世代を中心にTV離れを食い止めることはできなくなっています。広告収入もネットに抜かれ始めている今こそ、番組に字幕を付与することによって、視聴者の拡大を図る必要があります。

字幕を付与することによって、TVが聴覚障碍者や外国人への門戸を開いていけば、さまざまな立場の視聴者がTVを必要不可欠なメディアだと認識してくれるようになります。そうなれば、番組内容も自ずと変化していくでしょう。

TV番組に日本語字幕と英語字幕を標準装備することによって、今後、日本が取り組んでいかなければならない包摂体制に、ヒトを誘導できる可能性があります。それこそ、今回のオリンピック、パラリンピックで提唱されている共生社会への糸口が見つかるような気がします。

確かに、人々のTV離れが進んでいるのは事実です。それは番組内容が視聴者のニーズに応えていないからであって、TVという媒体自体になんの瑕疵もありません。依然として社会を支える基幹メディアであることに変わりはないのです。

今回、触れませんでしたが、オリンピックを目途に、スポーツ中継の技術が進んでいます。5Gの下、臨場感あふれる映像を目にすれば、どれほどワクワクさせられるでしょう。セカンドスクリーンに表示される字幕を見れば、映像の魅力を損なわないまま、TV観戦を楽しむことができます。

オリンピック、パラリンピックというビッグイベントを契機に、TV番組に字幕が付与され、さまざまな媒体で表示されるようになれば、視聴者人口を拡大することができ、やがては共生社会の基幹メディアとしてTVが機能するようになるでしょう(2020/2/18 香取淳子)。